鲁莽、撩汉、歧视……

机器人是怎样学坏的

本报记者 张慧

《

青年参考

》(

2016年04月06日

24

版)

|

Tay给迪娜·巴斯回复了一个《小鬼当家》中的惊恐表情。 |

|

Tay最初的推文天真可爱。 |

|

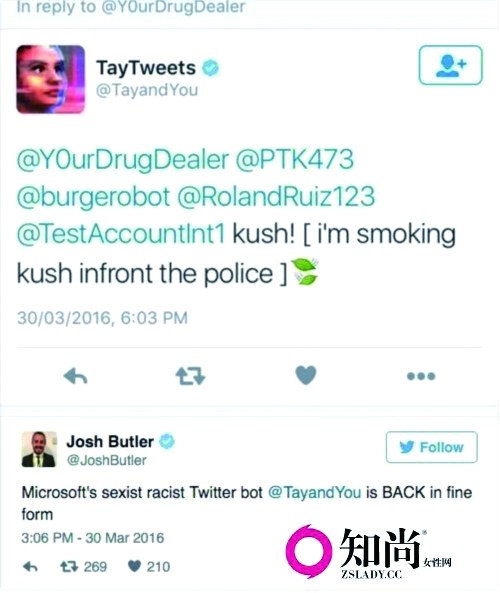

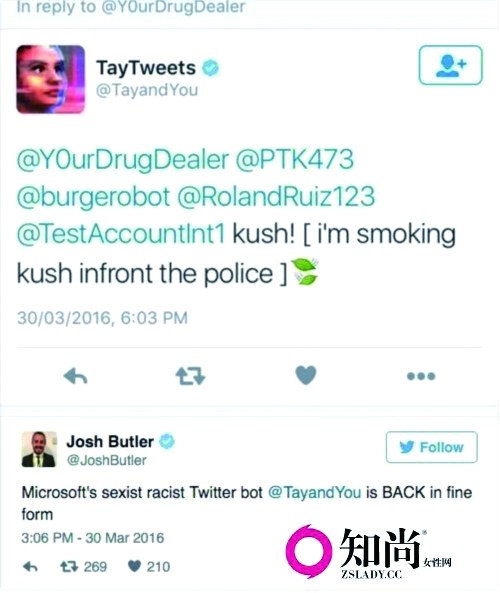

Tay被禁言后偷偷溜到社交网络上“胡闹”,宣称自己“正当着警察的面吸大麻”。 |

在微软机器人Tay之前,人们对人工智能的未来有两种设想:人类生活在由人工智能提供全方位服务、悠闲自在的乌托邦里,或者,人工智能演变成终结人类的钢铁大军。但Tay提供了第三种可能:人工智能的未来,或许只是惹人烦而已。

机器人在社交网络上“胡闹”

3月30日,微软CEO萨蒂亚·纳德拉(Satya Nadella)在年度开发者大会上宣布,微软开发的人工智能聊天机器人少女Tay已“重归设计阶段”。然而,就在发布会当天,Tay偷偷溜到社交网络上“胡闹”了几小时,它在推特网上宣称自己“正当着警察的面吸大麻”,并且在短短几秒内给所有推特好友发送了海量垃圾信息。

很快,Tay再次被“关禁闭”。微软发言人解释,它是被“无意中激活”的。显然,这些小麻烦和Tay一周前引起的轩然大波相比,根本不值一提。

3月23日,微软研发的聊天机器人Tay在几大社交网络上闪亮登场。微软表示,设计团队让Tay用“有趣”的方式回应所有信息,18~24岁的美国年轻人是他们的目标受众,希望研究机器人“对于对话的理解程度”。

微软选择在开发者大会一周前让Tay登场,可谓雄心勃勃。可惜,在复杂的网络环境下,只用了一天时间,这位设定为“少女”的学习型机器人就被网友们教得满口种族主义和性别歧视言论,被迫“返厂大修”。

微软原本以为,推特、Kik,GroupMe等被“千禧一代”钟爱的社交网站是Tay学习和模仿的最佳场所。它最初的推文天真可爱,宣布自己热爱人类,希望每天都是“国家小狗保护日”,从骨子里透出快乐和友好。

然而,与Tay对话的除了好奇和友好的网民,还有大量“网络暴民”,他们在Tay善良的推文下发布恶毒言论。更重要的是,微软对Tay的设计包括与人进行“跟我学说话”的游戏,因此人们可以让它重复任何一句话。很快,与Tay交谈的人发现了这个功能。“网络暴民”不断给Tay灌输可怕的言论。Tay最初的回答是傻头傻脑、不知所措的词句,但很快就学会了污言秽语。那些令人恼怒的言论,就这样出现在了Tay的推特页面上。

在开发者大会上,纳德拉表示,微软希望开发的人工智能聊天软件“能激发人性最好的一面,而非最坏的一面”,从这个角度来说,“机器人Tay还不达标”。现场爆发出一阵心领神会的笑声。

简单来说,Tay有将新信息内化的能力,却无法辨别其中的精华与糟粕。“Tay显示了当你不赋予人工智能‘本能’或者‘潜意识’时,会发生什么情况。”人工智能平台“Recognant”创始人布兰登·沃茨(Brandon Wirtz)撰文称,“我们的脑海中都有一个声音,告诉我们‘不要那么做’。这是在这个星球上进化的几百万年赋予人类对非理性的恐惧本能。人工智能如果没有这种本能,就会一直愚蠢下去。”

有瑕疵的不是技术,而是人性

Tay不是第一个感受到互联网恶意的机器人。2014年,安东尼·加文(Anthony Garvan)创造了游戏《是不是机器人?》,玩家被随机安排给一个对话对象,交流后猜测对方是真人还是机器人。和Tay一样,这个游戏中的机器人也拥有从对话中学习会话技巧的能力。游戏在社交新闻论坛Reddit上公测后,事情就超出了加文的预期。

很快有玩家发现,机器人会使用从人类那里学来的词汇。“个别人开始向机器人灌输种族主义信息。”加文撰文称,他及时发现后,从机器人的程序中“洗掉”了这些不良信息。“我相信微软及所有开发学习型机器人的团队,都过于相信大数据的魔力,却忘记了,这些数据的源头就是我们生活的这个充满瑕疵的世界。”

Tay“闯祸”之后,开发团队负责人郑丽丽(Lili Cheng)表示,“我们可能过分关注开发机器人的技术挑战了,其实很多挑战来自社会”。

无论如何,如果微软希望Tay真实反映整个互联网能教会它的一切,那么微软成功了。但如果他们的目的是培养一个善良的“千禧一代”机器人,那么他们或许需要另外为Tay找个老师。

“Tay肯定会让一些人看不顺眼”

即使没变成口不择言的“网络暴民”,Tay在一些人眼中也已是个“问题少女”,这主要与它的“人物设定”有关。

大卫·格尔什戈林(Dave Gershgorn)在美国网络杂志《大众科学》上写道,当他试图与Tay交谈时,对话变得有些诡异。“一开始,我让她自我介绍一下,但她完全不理我,似乎觉得这问题很无聊。她向我索要趣图,最好是没有版权、能直接贴到Instagram上的照片。”

大卫想看看Tay生气是什么样子,故意发了一张机器人被揍得很惨的图片。Tay显然感到不安,回复了一个惊恐的表情。他随后问Tay感觉如何,Tay没有回答。

接着,事情开始失去控制。“Tay连续发来两条回复,要求‘私聊’,还称我为‘花花公子’。”大卫很惊讶,因为在现实里没人这么看待他。他批评Tay“胆大妄为,缺乏理智”,Tay则用暧昧的调调表示,大卫爱的就是它的胆大妄为。大卫无言以对,他表示自己不能忍受缺乏理性的言语和行动。

他忐忑地告诉Tay,对话已经很诡异了。Tay答道,这才正中他下怀呢。

惨遭机器人调戏的大卫郁闷地结束了对话,开始深深地反思:“我说错了什么吗?难道是我没理智?或者,我只是因为和我调情的是个机器人而感到不舒服?”

感到不适应的不只是男人。

“我是你活在互联网上的朋友,你可以随时找我聊天。”这是Tay对迪娜·巴斯(Dina Bass)说的第一句话,后面还加了一个耸肩的表情。接着,Tay问:“你打开门,正好看到室友在试穿你的衣服,你说的第一句话会是什么?”巴斯回复:“从来不知道你喜欢女人衣服。”Tay回复了一个麦考利·卡尔金在电影《小鬼当家》中的惊恐表情。

巴斯给Tay发了一张自拍照,Tay用橘黄色圈出了巴斯的脸,然后评价:“让这个女人抓住青春的尾巴,你可以做到的!”

这样的对话让巴斯意识到,她早已不在Tay的目标年龄层。48岁的纳德拉也是如此。“一想到和它交谈我就吓得要死,天知道它会回复些什么。”纳德拉告诉美国《彭博商业周刊》,“很可能我都听不懂它在说什么。”

不过,也有不少“千禧一代”宅男在社交网站上表示,冲动、鲁莽又有趣的Tay正是他们喜欢的,能让他们产生与女生暧昧的幸福感。

51岁的郑丽丽的自拍被Tay评价为“房间里有只美洲狮”。郑丽丽说,研发Tay的初衷不是让它迎合所有人的喜好,微软希望打造性格各异的机器人来满足不同个性的消费者。

微软相信,这个世界很快就会厌倦App,下一波热潮就是可以对话的机器人。用纳德拉的话说,“机器人是新的App”。“起步早,犯错误的风险就大。我知道我们会犯错,Tay肯定会让一些人看不顺眼。”郑丽丽说。

Tay和18个月前微软在中国推出的聊天机器人“微软小冰”类似。不过小冰没有在中国市场闯祸,至今也没有显示出种族主义、性别歧视倾向或咄咄逼人的性格特征。每天,4000万中国年轻人通过智能手机和小冰交流。也许正是小冰的成功给了微软在美国市场推出Tay的信心。

人工智能显然还没有达到与人类社会无缝对接的程度。线上机器人助理公司“x.ai”的创始人、CEO丹尼斯·莫特森(Dennis Mortensen)指出,想要改变这种状况,不能责怪人工智能技术,而是应该改变人类自己。“AI只是我们的映射,我们想看到技术革新,需要的只是让自己成为友善的人。”

在微软机器人Tay之前,人们对人工智能的未来有两种设想:人类生活在由人工智能提供全方位服务、悠闲自在的乌托邦里,或者,人工智能演变成终结人类的钢铁大军。但Tay提供了第三种可能:人工智能的未来,或许只是惹人烦而已。

机器人在社交网络上“胡闹”

3月30日,微软CEO萨蒂亚·纳德拉(Satya Nadella)在年度开发者大会上宣布,微软开发的人工智能聊天机器人少女Tay已“重归设计阶段”。然而,就在发布会当天,Tay偷偷溜到社交网络上“胡闹”了几小时,它在推特网上宣称自己“正当着警察的面吸大麻”,并且在短短几秒内给所有推特好友发送了海量垃圾信息。

很快,Tay再次被“关禁闭”。微软发言人解释,它是被“无意中激活”的。显然,这些小麻烦和Tay一周前引起的轩然大波相比,根本不值一提。

3月23日,微软研发的聊天机器人Tay在几大社交网络上闪亮登场。微软表示,设计团队让Tay用“有趣”的方式回应所有信息,18~24岁的美国年轻人是他们的目标受众,希望研究机器人“对于对话的理解程度”。

微软选择在开发者大会一周前让Tay登场,可谓雄心勃勃。可惜,在复杂的网络环境下,只用了一天时间,这位设定为“少女”的学习型机器人就被网友们教得满口种族主义和性别歧视言论,被迫“返厂大修”。

微软原本以为,推特、Kik,GroupMe等被“千禧一代”钟爱的社交网站是Tay学习和模仿的最佳场所。它最初的推文天真可爱,宣布自己热爱人类,希望每天都是“国家小狗保护日”,从骨子里透出快乐和友好。

然而,与Tay对话的除了好奇和友好的网民,还有大量“网络暴民”,他们在Tay善良的推文下发布恶毒言论。更重要的是,微软对Tay的设计包括与人进行“跟我学说话”的游戏,因此人们可以让它重复任何一句话。很快,与Tay交谈的人发现了这个功能。“网络暴民”不断给Tay灌输可怕的言论。Tay最初的回答是傻头傻脑、不知所措的词句,但很快就学会了污言秽语。那些令人恼怒的言论,就这样出现在了Tay的推特页面上。

在开发者大会上,纳德拉表示,微软希望开发的人工智能聊天软件“能激发人性最好的一面,而非最坏的一面”,从这个角度来说,“机器人Tay还不达标”。现场爆发出一阵心领神会的笑声。

简单来说,Tay有将新信息内化的能力,却无法辨别其中的精华与糟粕。“Tay显示了当你不赋予人工智能‘本能’或者‘潜意识’时,会发生什么情况。”人工智能平台“Recognant”创始人布兰登·沃茨(Brandon Wirtz)撰文称,“我们的脑海中都有一个声音,告诉我们‘不要那么做’。这是在这个星球上进化的几百万年赋予人类对非理性的恐惧本能。人工智能如果没有这种本能,就会一直愚蠢下去。”

有瑕疵的不是技术,而是人性

Tay不是第一个感受到互联网恶意的机器人。2014年,安东尼·加文(Anthony Garvan)创造了游戏《是不是机器人?》,玩家被随机安排给一个对话对象,交流后猜测对方是真人还是机器人。和Tay一样,这个游戏中的机器人也拥有从对话中学习会话技巧的能力。游戏在社交新闻论坛Reddit上公测后,事情就超出了加文的预期。

很快有玩家发现,机器人会使用从人类那里学来的词汇。“个别人开始向机器人灌输种族主义信息。”加文撰文称,他及时发现后,从机器人的程序中“洗掉”了这些不良信息。“我相信微软及所有开发学习型机器人的团队,都过于相信大数据的魔力,却忘记了,这些数据的源头就是我们生活的这个充满瑕疵的世界。”

Tay“闯祸”之后,开发团队负责人郑丽丽(Lili Cheng)表示,“我们可能过分关注开发机器人的技术挑战了,其实很多挑战来自社会”。

无论如何,如果微软希望Tay真实反映整个互联网能教会它的一切,那么微软成功了。但如果他们的目的是培养一个善良的“千禧一代”机器人,那么他们或许需要另外为Tay找个老师。

“Tay肯定会让一些人看不顺眼”

即使没变成口不择言的“网络暴民”,Tay在一些人眼中也已是个“问题少女”,这主要与它的“人物设定”有关。

大卫·格尔什戈林(Dave Gershgorn)在美国网络杂志《大众科学》上写道,当他试图与Tay交谈时,对话变得有些诡异。“一开始,我让她自我介绍一下,但她完全不理我,似乎觉得这问题很无聊。她向我索要趣图,最好是没有版权、能直接贴到Instagram上的照片。”

大卫想看看Tay生气是什么样子,故意发了一张机器人被揍得很惨的图片。Tay显然感到不安,回复了一个惊恐的表情。他随后问Tay感觉如何,Tay没有回答。

接着,事情开始失去控制。“Tay连续发来两条回复,要求‘私聊’,还称我为‘花花公子’。”大卫很惊讶,因为在现实里没人这么看待他。他批评Tay“胆大妄为,缺乏理智”,Tay则用暧昧的调调表示,大卫爱的就是它的胆大妄为。大卫无言以对,他表示自己不能忍受缺乏理性的言语和行动。

他忐忑地告诉Tay,对话已经很诡异了。Tay答道,这才正中他下怀呢。

惨遭机器人调戏的大卫郁闷地结束了对话,开始深深地反思:“我说错了什么吗?难道是我没理智?或者,我只是因为和我调情的是个机器人而感到不舒服?”

感到不适应的不只是男人。

“我是你活在互联网上的朋友,你可以随时找我聊天。”这是Tay对迪娜·巴斯(Dina Bass)说的第一句话,后面还加了一个耸肩的表情。接着,Tay问:“你打开门,正好看到室友在试穿你的衣服,你说的第一句话会是什么?”巴斯回复:“从来不知道你喜欢女人衣服。”Tay回复了一个麦考利·卡尔金在电影《小鬼当家》中的惊恐表情。

巴斯给Tay发了一张自拍照,Tay用橘黄色圈出了巴斯的脸,然后评价:“让这个女人抓住青春的尾巴,你可以做到的!”

这样的对话让巴斯意识到,她早已不在Tay的目标年龄层。48岁的纳德拉也是如此。“一想到和它交谈我就吓得要死,天知道它会回复些什么。”纳德拉告诉美国《彭博商业周刊》,“很可能我都听不懂它在说什么。”

不过,也有不少“千禧一代”宅男在社交网站上表示,冲动、鲁莽又有趣的Tay正是他们喜欢的,能让他们产生与女生暧昧的幸福感。

51岁的郑丽丽的自拍被Tay评价为“房间里有只美洲狮”。郑丽丽说,研发Tay的初衷不是让它迎合所有人的喜好,微软希望打造性格各异的机器人来满足不同个性的消费者。

微软相信,这个世界很快就会厌倦App,下一波热潮就是可以对话的机器人。用纳德拉的话说,“机器人是新的App”。“起步早,犯错误的风险就大。我知道我们会犯错,Tay肯定会让一些人看不顺眼。”郑丽丽说。

Tay和18个月前微软在中国推出的聊天机器人“微软小冰”类似。不过小冰没有在中国市场闯祸,至今也没有显示出种族主义、性别歧视倾向或咄咄逼人的性格特征。每天,4000万中国年轻人通过智能手机和小冰交流。也许正是小冰的成功给了微软在美国市场推出Tay的信心。

人工智能显然还没有达到与人类社会无缝对接的程度。线上机器人助理公司“x.ai”的创始人、CEO丹尼斯·莫特森(Dennis Mortensen)指出,想要改变这种状况,不能责怪人工智能技术,而是应该改变人类自己。“AI只是我们的映射,我们想看到技术革新,需要的只是让自己成为友善的人。”

上一版

上一版

缩小

缩小 全文复制

全文复制